危爆物品探测技术国家工程研究中心王生进、李亚利团队博士生豆朝鹏的论文《面向域泛化行人再识别的身份导向自监督表征学习》(Identity-Seeking Self-Supervised Representation Learning for Generalizable Person Re-identification)于2023年8月12日被国际计算机视觉大会(IEEE International Conference on Computer Vision, ICCV2023)接收为Oral。当地时间10月6日,豆朝鹏赴法国巴黎参加该学术会议并作大会口头报告。ICCV2023的有效投稿数为8088,最终接收了2160篇文章,接收率约26.7%,共有152篇论文被接收为口头报告(Oral),接收率仅1.9%。

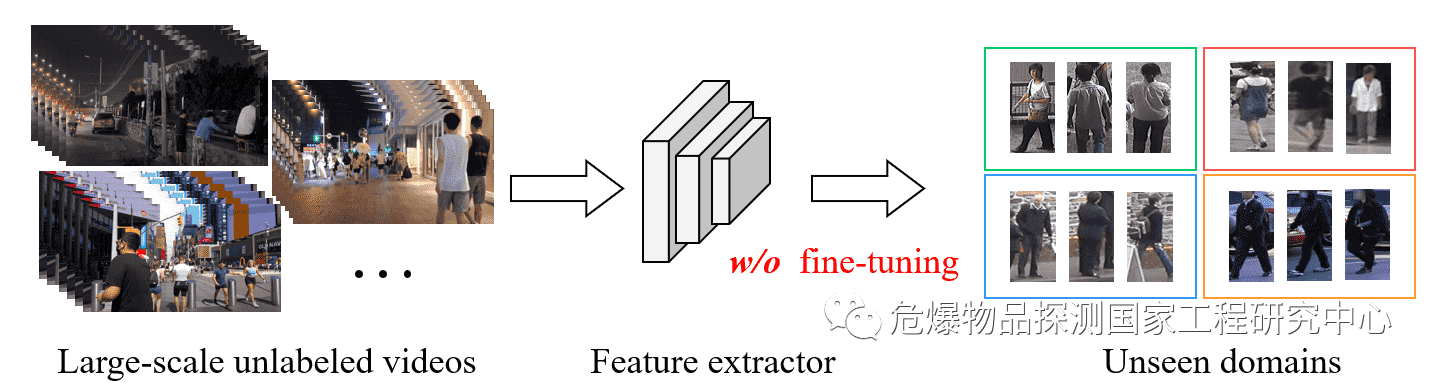

该论文解决的是域泛化行人再识别任务(Domain-Generalizable Person Re-identification, DG ReID)中的重要难题——在未知的目标域上进行测试时,模型的性能大幅下降问题。解决该问题的常见做法是在小规模的有标注数据上学习域不变的行人表征。然而,这种方法受限于训练数据的规模,域信息匮乏,难以学到泛化能力强的行人表征。为此,豆朝鹏等作者提出新的解决思路,如图1所示,从大规模的无标注互联网行人视频中学习域泛化能力强的行人表征。该方案的可行性来自于两点:(1)从互联网获取无标注的行人视频代价极低。(2)大规模的互联网视频数据包含丰富的域信息,能学习到泛化能力强的行人表征。

图1 解决思路:从大规模无标注视频中学习域泛化行人表征

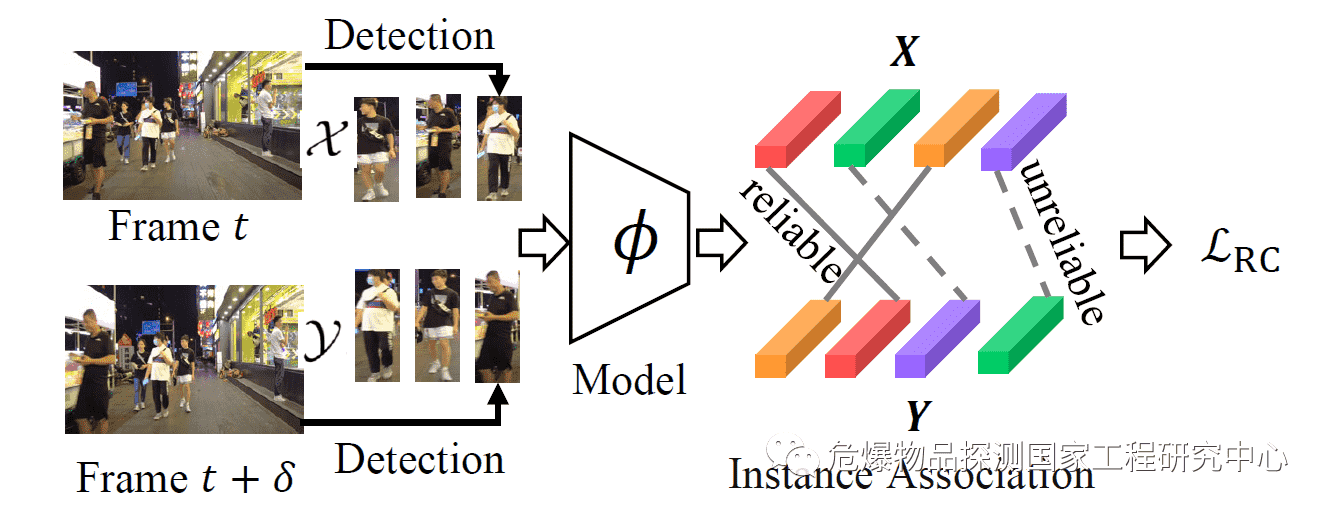

对于大规模的无标注数据,一个朴素的做法是采用经典的无监督对比学习方法,如MoCo、SimCLR、BYOL等训练模型。然而经过分析,作者发现这些无监督对比学习方法不适用于行人再识别任务。行人再识别任务要求属于同一个行人的多张图像具有相似的表征,而MoCo等方法为每一张图像学习唯一的表征,与行人再识别任务的要求不一致。为了能够驱动大规模的无标注数据来学习域泛化行人表征,作者提出了身份导向的自监督表征学习框架(Identity-Seeking Self-Supervised Representation Learning, ISR)。如图 2示,该框架包括两个主要部分:(1)基于最大二分图匹配构建跨帧正样本对。(2)基于所提出的可靠性引导的对比学习损失,抑制噪声正样本对的影响。ISR要求邻近帧中属于同一个行人的图像具有相似的表征,这与行人再识别任务的要求一致。ISR的训练复杂度和训练数据量呈线性关系,因此能够驱动大规模的训练数据。

图2 方法框架:身份导向自监督表征学习框架ISR

广泛的实验结果表明,ISR学习的表征具有很强的域泛化能力和域迁移能力。在域泛化设定中,在7个常用的行人数据集上,ISR的性能大幅超越了现有的工作。在域适应设定中,ISR学习的表征能够更快速、更有效地适应新场景,有很大的实际部署潜力和价值。这些结果表明,该论文所提出的结合自监督对比学习和大规模无标注行人数据是解决行人再识别任务中的泛化问题的有效方法,这是迈向域泛化行人再识别的一大突破!

ICCV会议由电气与电子工程师学会(The Institute of Electrical and Electronics Engineers, IEEE)举办,与计算机视觉模式识别会议(IEEE Conference on Computer Vision and Pattern Recognition , CVPR)和欧洲计算机视觉会议(European Conference on Computer Vision, ECCV)并称计算机视觉方向的三大会议,被中国计算机学会等机构评为最高级别的学术会议,在业内具有极高的评价,拥有极高的领域影响力。研究中心王生进、李亚利团队在机器学习和计算机视觉研究领域取得了突出成果,多次获得学术奖励,论文单篇引用逾4000次。该篇论文是继该团队在国际先进人工智能协会的人工智能会议(AAAI Conference on Artificial Intelligence, AAAI)和国际声学、语音与信号处理会议(International Conference on Acoustics, Speech and Signal Processing, ICASSP)上发表Oral论文之后的又一篇顶级国际学术会议Oral论文。

论文链接:https://openaccess.thecvf.com/content/ICCV2023/papers/Dou_Identity-Seeking_Self-Supervised_Representation_Learning_for_Generalizable_Person_Re-Identification_ICCV_2023_paper.pdf